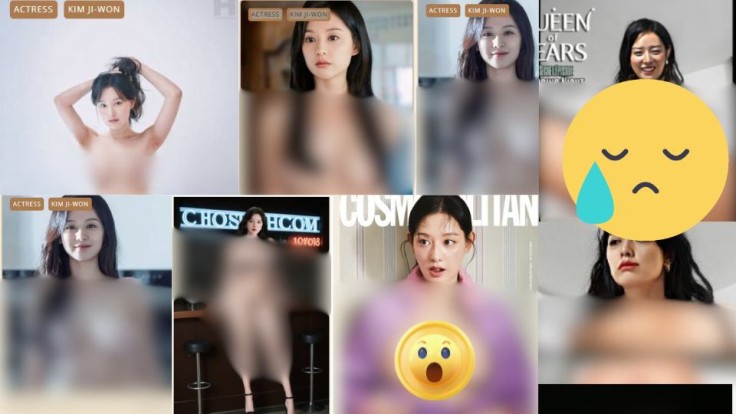

Horror digital: circulan en línea más de 1100 vídeos porno deepfake con celebridades coreanas

Un escándalo de pornografía deepfake que involucra a celebridades y menores coreanos ha sacudido a ese país, ya que las autoridades confirmaron el arresto de 83 personas que operaban salas de chat ilegales de Telegram utilizadas para distribuir contenido explícito generado por IA.

Te puede interesar: Nick Carter de los Backstreet Boys suma cinco acusaciones de violación: detalles de una nueva demanda en su contra

La Agencia de Policía Provincial de Gyeonggi del Norte anunció que 23 personas fueron detenidas por violar la Ley de Protección Sexual de Niños y Jóvenes y la Ley Especial sobre el Castigo de los Delitos de Violencia Sexual.

Otros 60 participantes varones también fueron detenidos.

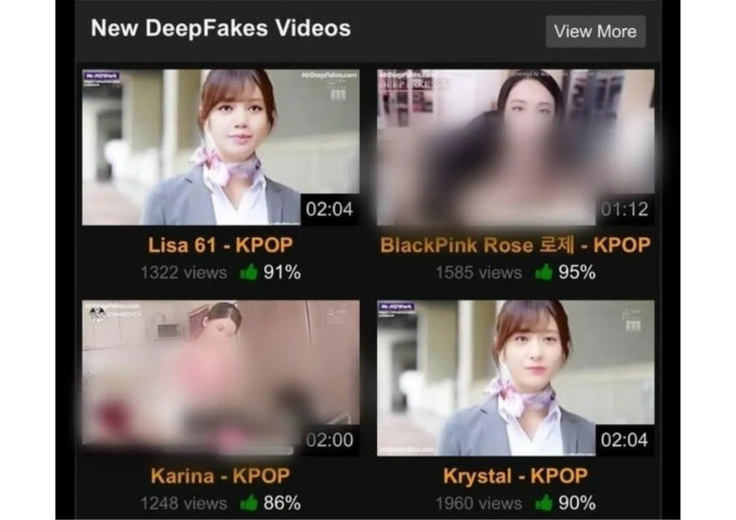

El grupo está acusado de crear más de 1.100 vídeos pornográficos deepfake, incluidos aproximadamente 30 que muestran a ídolos femeninos del K-pop y otras celebridades sin su consentimiento.

"Esto no es sólo una broma o un chiste anónimo.

"Es un delito grave", dijo el presidente surcoreano, Yoon Suk-yeol, durante una reunión del gabinete la semana pasada.

Muchas de las víctimas son menores de edad y la mayoría de los agresores son adolescentes y adultos jóvenes.

Según la policía , los vídeos fueron producidos y distribuidos a través de canales privados de Telegram, algunos de los cuales tenían más de 20.000 suscriptores.

Gran parte de las imágenes utilizadas fueron extraídas de publicaciones en redes sociales, retratos de graduación y sitios web universitarios.

El caso ha sido comparado con el notorio caso "Nth Room" de Corea del Sur en 2020, que involucró chantaje y explotación sexual de mujeres y menores.

Pero las autoridades dicen que la naturaleza de estos delitos ha evolucionado y ahora dependen de una inteligencia artificial avanzada para fabricar contenido explícito, a menudo sin el conocimiento de la víctima.

Park Sung-hye, jefe del equipo de eliminación de delitos del Centro de Apoyo a Víctimas de Delitos Sexuales Digitales, dijo que los niños menores de 10 años ahora son al mismo tiempo víctimas y perpetradores.

"Algunos niños usan fotos de compañeros de clase o incluso de profesores. No siempre comprenden la gravedad", dijo Park.

"La tecnología es de fácil acceso y las consecuencias son devastadoras".

Los datos del Instituto de Derechos Humanos de las Mujeres de Corea revelaron que el 92,6% de las víctimas de delitos sexuales deepfake en 2024 eran adolescentes.

El número de casos denunciados de contenido manipulado se disparó de 1.384 en 2023 a más de 10.305 el año pasado.

Un caso reciente involucró a un hombre de 28 años, condenado a cinco años de prisión por crear vídeos deepfake sexualmente explícitos en los que aparecían mujeres, entre ellas al menos una exalumna de la Universidad Nacional de Seúl. En otro incidente, cuatro hombres fueron condenados por producir al menos 400 vídeos falsos con imágenes de estudiantes universitarias.

El tribunal calificó sus acciones como "indescriptiblemente degradantes".

El gobierno coreano ha prometido una aplicación más estricta.

La Agencia Nacional de Policía dijo que mejorará la vigilancia digital y cooperará con plataformas como Telegram, que ha abierto una línea directa con los reguladores coreanos.

"Estos delitos se esconden a simple vista: en nuestros teléfonos inteligentes, nuestras escuelas y nuestras comunidades en línea", declaró el presidente Yoon. "Debemos eliminarlos".

El último escándalo ha provocado pedidos urgentes de una regulación más profunda de las herramientas de IA y las plataformas en línea en medio de crecientes preocupaciones sobre el consentimiento digital, la privacidad y la explotación.